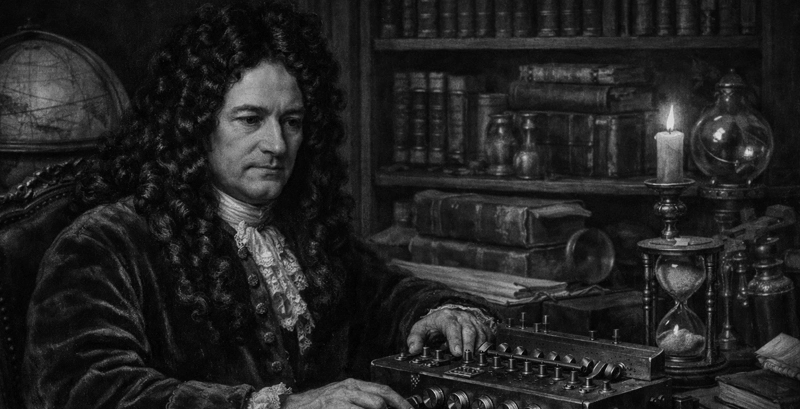

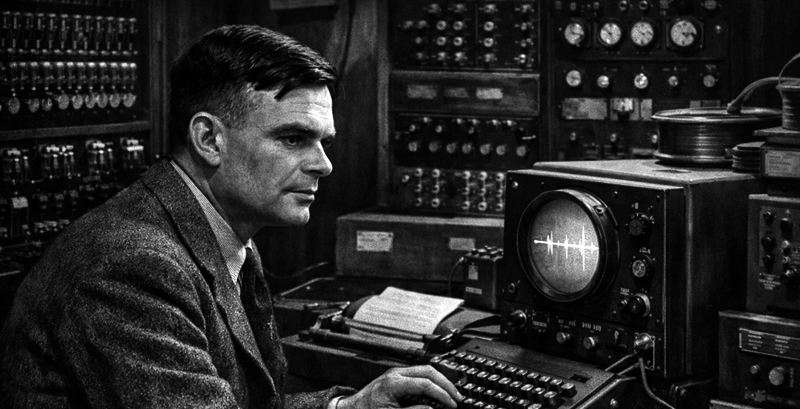

(*) - Todas as imagens que ilustram este artigo foram geradas por IA (Google Gemini e Copilot)

Há coisa de dois anos ou pouco menos, computadores pessoais e smartphones foram alcançados por um serviço diferente. Softwares e aplicativos de inteligência artificial (IA) começaram a dar respostas, inclusive às nossas perguntas mais tolas, e apareceram nos serviços de busca.

E passaram a fazer desenhos segundo nossas orientações, melhorar fotos, traduzir, criar música, diagnosticar, escrever, ler mapas, montar aulas e muito mais. Algumas vezes, errando e “delirando”, mas, na média, com entregas que atendem as expectativas.

Uma transformação ainda mais surpreendente pelo inusitado de seu surgimento: de repente, a IA entrou na vida das pessoas comuns.

Uma entrada disruptiva, sem dúvida. Mas, será que a descoberta também foi disruptiva? Ou ela nasceu de um processo mais longo, com base – será – na Antiguidade?

Neste artigo especial, vamos investigar a origem da IA, dando uma passadinha, também, por seu futuro. Venha com a gente!

Mas afinal, o que é Inteligência Artificial?

Essa é uma boa pergunta para iniciar nossa jornada. Afinal, a tecnologia chegou às pessoas com o nome de Inteligência Artificial (IA) – e isto, definitivamente, humanizou nossa percepção da tecnologia.

Mas o que é, exatamente, inteligência? E o termo “artificial”, por que foi usado?

A palavra inteligência vem do latim intellegere e significa, literalmente, “ler entre” ou saber escolher entre diferentes objetos ou alternativas. Para a ciência, não existe um único conceito de inteligência – em nosso texto, porém, adotamos a definição científica geral de que ela é a capacidade de adquirir e aplicar conhecimentos, resolver problemas, adaptar-se a novas situações e aprender com a experiência.

E, em relação ao termo artificial (também de origem latina), a ideia é de que se trata de algo que se tornou possível graças a um artifício, ou seja, a uma habilidade ou técnica desenvolvida pelo homem. E que age fora do cérebro humano.

Assim, inteligência artificial pode ser entendida como a capacidade de adquirir e aplicar conhecimentos, resolver problemas, adaptar-se a novas situações e aprender com a experiência – algo eminentemente humano – instalada em um dispositivo construído por um ser humano.

A IA, então, não é apenas uma imitação ou emulação da comunicação humana, mas uma tecnologia que também gerencia conhecimentos e aprende com a própria experiência.

A partir daqui, podemos descobrir quando começou a jornada de “implantar inteligência na máquina”.

Sonhos, reflexões e estudos

Podemos dividir nossa investigação em dois aspectos que acabam se conectando.

Em um primeiro momento, temos o sonho humano, o desejo de construir autômatos e seres dotados de inteligência.

Ele aparecia nos mitos e no pensamento filosófico grego (como nos autômatos construídos pelo deus ferreiro Hefesto - imagem abaixo), entre os judeus medievais com o Golem (um autômato construído magicamente por rabinos) – e também na China, com aqueles que são considerados os primeiros robôs humanoides, descritos em textos clássicos.

Por muito tempo, foi só um sonho; nascido, porém, de mentes que também criariam a filosofia e, a partir dela, desenvolveram o pensamento científico, na Europa a partir do século XVII.

E é exatamente nesse período, com pensadores como René Descartes (1596-1650) e Gottfried Leibniz (1646-1716), que têm início esforços no sentido de se “traduzir a razão” em termos matemáticos, com a lógica e o raciocínio mecânico (o mesmo que “dá vida” às calculadoras).

“Ombros de gigantes”

A referência, neste subtítulo, é a uma frase escrita por Isaac Newton (que ele emprestou de um pensador medieval, Bernardo de Chartres) para indicar que a ciência é cumulativa.

Os avanços na Matemática e na Ciência da Computação propiciados por pesquisadores como Leibniz (imagem abaixo), George Boole (1815–1864), Charles Babbage (1791–1871) e Ada Lovelace (1815–1852) serviram de base para que, no século XX, outros cientistas chegassem mais perto de um “pensamento computacional” e da arquitetura mais próxima do que conhecemos como IA. Esses trabalhos avançaram pela lógica simbólica (que possibilitou a invenção dos circuitos digitais), o cálculo universal (que permitiu as linguagens formais) e a programação.

A “máquina universal”

Em 1936, Alan Turing (1912–1954 - imagem abaixo) formulou o conceito de “máquina universal”, um modelo que mostra que uma única máquina pode realizar qualquer tarefa computacional desde que seja programada corretamente. Esse conceito fundamenta os computadores de uso geral.

Pouco mais tarde (1945), John Von Neumann (1903-1957) estabeleceu o que conhecemos, hoje, como arquitetura de programa armazenado, que está em praticamente todos os computadores (e que prevê uma unidade central de processamento, CPU, memória e dispositivos de entrada/saída).

Em 1950, no artigo “Computing Machinery and Intelligence”, Turing propôs um teste para avaliar se uma máquina poderia ser considerada “inteligente”. Esse teste, que se conecta diretamente à ideia de IA, estabelece o seguinte: “se um interrogador humano, em uma conversa escrita, não conseguir distinguir entre as respostas de um humano e de uma máquina, então podemos dizer que a máquina ‘pensa’”.

Nasce a IA

Cada contribuição foi essencial para a moldagem da IA que conhecemos.

Entre os anos 1960 e 1980, os estudos caminharam para a “IA simbólica”, que se baseava em lógica formal e representações simbólicas para simular o raciocínio humano em computadores e modelos matemáticos.

Em 1966, o programa de computador “ELIZA” ficou famoso por simular conversas com um psicoterapeuta; e os sistemas “especialistas” começaram a aplicar regras de conhecimento para resolver problemas de Medicina e Engenharia.

Nos anos 1980, os primeiros jogos digitais de RPG também “namoravam” com uma característica da IA: quando perguntavam ao usuário “O que devo fazer agora?” esperando uma resposta que permitisse avançar na jornada, simulavam a interação humana – uma característica essencial da IA. Essa característica, aliás, é chave no Teste de Turing.

O salto

Nos anos 1990 houve uma nova expansão. Se, até então, os sistemas que simulavam inteligência se baseavam em regras fixas e mais “duras”, eles começaram a incorporar dados estatísticos e algoritmos (equações) de aprendizado.

Com isso, ganharam flexibilidade de resposta – outra característica humanizante. Ao mesmo tempo, surgiram aplicações computacionais que focavam em reconhecimento de padrões, como os de escrita e voz.

Em 1997, um choque: pela primeira vez, um supercomputador – o Deep Blue, da IBM –, derrotou um superenxadrista, Garry Kasparov, mostrando a proximidade entre sua forma de “raciocinar” e o pensamento complexo humano.

Nos anos 2000, se unem ao processo (depois de um desenvolvimento de quase 50 anos) as redes neurais artificiais, modelos matemáticos inspirados no funcionamento do cérebro humano. Elas são compostas por camadas de neurônios artificiais (linhas de programa ou mesmo chips) que recebem dados, processam e transmitem resultados. Conectadas à IA, forneceram a “autonomia intelectual” que vemos hoje nesses sistemas.

Os sistemas, então, conseguiam falar e sabiam pensar.

Para a etapa seguinte, que estamos vivendo agora (mas que começou por volta do ano 2000), faltava apenas conhecimento, isto é, acesso a uma massa de dados (Big Data) que permitisse aos sistemas expandir a capacidade de processamento e construção de respostas.

Essa massa de dados está na internet, nos trilhões de informações que chegam a cada dia aos bancos de dados e que alimentam os algoritmos.

Aí, inclusive, reside a chave da chamada IA Generativa (vista em ferramentas como ChatGPT, MidJourney, Copilot e DeepSeek), em que não há uma simples organização-repetição de dados conhecidos, mas a criação de novos conteúdos. É nesse estágio que nos encontramos agora.

Conclusão: esta IA é IA de verdade? E o que vem por aí?

Quando falamos de IA, não costumamos relacioná-la, por exemplo, com emoções ou subjetividade. E você sabe por quê? Porque esses elementos não estão lá! Eles são tão sofisticados – e emergem de uma estrutura tão complexa, o cérebro humano – que a ciência ainda não os alcançou.

Diante disso, é possível afirmar que a IA, hoje, é uma simulação extremamente bem-feita, e que pode ser cada vez mais refinada para uma mimese quase completa com os seres humanos. Não mais do que isso, porém.

E o que faltaria para a criação de uma inteligência artificial real, isto é, modulada por emoções e dotada de subjetividade? Que fosse indistinguível da inteligência humana, a ponto de perder o qualificativo “artificial”?

A ciência, é claro, trabalha nessa questão. Ainda não há meios, porém, para esse novo salto – o salto definitivo? – da IA. Dotar a máquina de uma noção de “Eu”, fazê-la sentir emoções (a chamada IA afetiva), permitir que tenha objetivos e vontade própria, que tenha um corpo físico capaz de fornecer informações que um sistema digital simplesmente não alcança.

Um avanço tão exponencial, porém, implicaria questões éticas sérias e reflexos profundos na vida das pessoas. Que exigiriam discussão prévia, normatização e acompanhamento cuidadoso pela sociedade. Esse debate, aliás, deveria começar agora, em escolas, universidades e governos.

Na sua opinião, a humanidade estaria pronta para essa nova etapa?

04 de maio de 2026

“Então, vamos ao museu?” Novidades e desafios dos museus do nosso tempo

É um fenômeno global: em todo o mundo, as pessoas estão retornando aos museus. E isso tem explicação! Em um artigo especial, falamos sobre o "renascimento" dos museus e os desafios para que eles cheguem ainda mais longe em sua missão cultural. Confira!

23 de abril de 2026

IA Indica: apoio aos educadores, força para os planos de intervenção

Novidade no ar: as equipes de Tecnologia Educacional (TE) e do Programa Indica estão finalizando o desenvolvimento de uma ferramenta de Inteligência Artificial (IA) que em breve vai tornar os planos de intervenção dos municípios e escolas privadas mais precisos e eficientes.

02 de abril de 2026

Ciência: afinal, quando começou a IA? E o que pode vir por aí?

A sensação que a gente tem é de que a IA "surgiu do nada" para mudar muito nossas vidas. E, de fato, ela surgiu muito rápido e de tornou um fenômeno. Mas, será que foi assim tão repentino? E qual sua próxima etapa? Descubra as respostas neste artigo especial para o Ígnea!